- Published on

BA02.[Phụ lục 1] Động cơ Bayesian: Thuật giả kim toán học để quản lý sự không chắc chắn

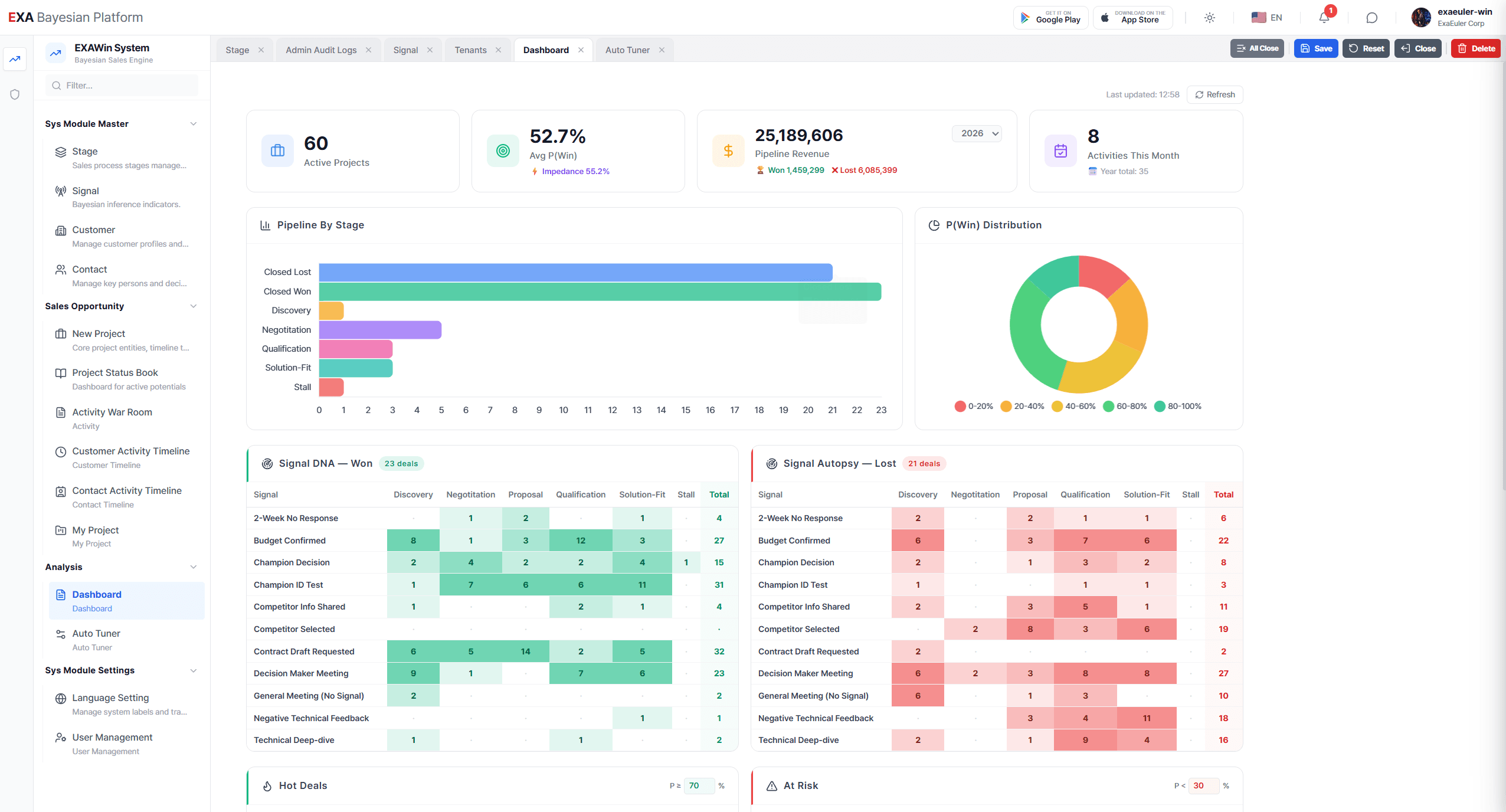

![BA02.[Phụ lục 1] Động cơ Bayesian: Thuật giả kim toán học để quản lý sự không chắc chắn](/_next/image?url=%2Fstatic%2Fimages%2FBA02_1.png&w=3840&q=75)

Thay thế trực giác bằng ngôn ngữ toán học

Bài viết này giải thích các nguyên lý toán học và tính hiệu quả của động cơ Bayesian đã được đề cập trong Tập BA02. Mục tiêu là để dự đoán chính xác xác suất thành công trong bán hàng trong một môi trường kinh doanh không chắc chắn. Về cốt lõi, nó đề cập đến quá trình đưa ra các chỉ số quyết định tối ưu bằng cách kết hợp phân phối Beta, giúp định lượng các kinh nghiệm trong quá khứ, và phân phối Nhị thức, giúp nắm bắt các tín hiệu thời gian thực từ hiện trường. Đặc biệt, bài viết nhấn mạnh việc tối đa hóa tính thời gian thực và hiệu quả tính toán của hệ thống bằng cách sử dụng phân phối Tiên nghiệm liên hợp, cho phép cập nhật tức thì mà không cần các phép toán phức tạp. Ngoài ra, mô hình này áp dụng phương pháp ước lượng đệ quy giúp đưa ra phán đoán ngay khi dữ liệu phát sinh, đảm bảo tính hợp lý về mặt kỹ thuật được tối ưu hóa cho kinh doanh hiện đại. Kết quả là, tài liệu này cho thấy rõ ràng cách mô hình hóa toán học tinh vi chuyển đổi trực giác mơ hồ thành những hiểu biết sâu sắc dựa trên dữ liệu đáng tin cậy.

Trong màn sương của kinh doanh, các giám đốc bán hàng, những người quản lý phải đưa ra quyết định, và ban điều hành luôn cảm thấy khao khát. Đó là câu trả lời cho câu hỏi: "Tỷ lệ thắng trong tình huống này ngay lúc này là bao nhiêu phần trăm?". 'Động cơ Bayesian (Bayesian Engine)', trái tim của hệ thống Exa, dịch quy trình trừu tượng này sang ngôn ngữ tinh vi nhất: toán học.

Trong bài viết này, chúng ta sẽ phân tích sâu các cột trụ toán học hỗ trợ kiến trúc của động cơ này trong môi trường bán hàng hoặc các tình huống tương tự, và tại sao đây là 'giải pháp tối ưu' trong môi trường doanh nghiệp.

Mặt khác, các mô hình Bayesian dựa trên MCMC hoặc Deep Learning là tài sản vĩ đại của nhân loại để giải quyết các vấn đề phức tạp đa chiều. Tuy nhiên, việc nhấn mạnh rằng 'hiệu quả toán học' và 'sự rõ ràng' của mô hình Beta-Nhị thức là vũ khí mạnh mẽ nhất trong các lĩnh vực cụ thể như suy luận xác suất thành công bán hàng cũng là một cách để đảm bảo tính khách quan về kỹ thuật.

Lưu ý: Động cơ AI của Exa sử dụng toán học Bayesian phù hợp tùy theo từng tình huống cụ thể. Vì các tình huống áp dụng rất đa dạng, hầu hết các phép toán Bayesian đều được áp dụng, và các công nghệ AI đã được kiểm chứng tại hiện trường—như ML (Học máy), DL (Học sâu), RL (Học tăng cường), LLM (AI tạo sinh)—được huy động bên trong động cơ theo nhu cầu của kinh doanh. Bài viết này chỉ tập trung vào nội dung kỹ thuật của toán học được sử dụng trong tập bán hàng.

Phản ánh bối cảnh này, trong khi tôn trọng lý do tồn tại của mỗi công nghệ, tôi dự định mô tả một cách logic tại sao các công nghệ được sử dụng trong tập này là 'Tiêu chuẩn vàng (Golden Standard)' trong lĩnh vực này.

1. Định lượng kinh nghiệm: 'Phân phối Beta (Beta Distribution)' như một phân phối tiên nghiệm

Tất cả các suy luận Bayesian đều bắt đầu từ tính chủ quan, trực giác, niềm tin của cá nhân (các bên liên quan), hoặc dữ liệu thực nghiệm đã được nghiên cứu hoặc đã biết của lĩnh vực đó, nói cách khác là 'bắt đầu bằng việc tin vào điều gì'. Trong trường hợp của loại kịch bản này, mô hình chứa đựng trạng thái ban đầu của kinh doanh hoặc kinh nghiệm tích lũy vào một chiếc bình gọi là phân phối Beta.

1.1 Định nghĩa toán học

Phân phối Beta là một hàm mật độ xác suất được tối ưu hóa để xử lý các giá trị xác suất từ 0 đến 1. Hàm được định nghĩa bởi công thức dưới đây. Chi tiết về phân phối Beta sẽ được giải thích trong một bài viết khác mổ xẻ về phân phối Beta.

Ở đây mẫu số α, β là hàm Beta, một hằng số chuẩn hóa giúp tổng các xác suất bằng 1, và động lực cốt lõi là hai tham số α và β.

α (Alpha): Cường độ của bằng chứng tích lũy cho sự thành công

β (Beta): Cường độ của bằng chứng tích lũy cho rủi ro hoặc thất bại

1.2 Giải thích

Hãy nhìn vào cấu trúc của tử số trong công thức. Khi α tăng lên, tâm của phân phối sẽ di chuyển về phía 1 (thành công), và khi β tăng lên, nó di chuyển về phía 0 (thất bại).

Vào thời điểm bắt đầu kinh doanh, dựa trên thống kê thị trường, chúng ta có thể gán các giá trị như α=2, β=8. Điều này hình thành 'kiến thức thực nghiệm tiên nghiệm' rằng "cho đến nay, 2 trong số 10 lần là thành công" thành một đường cong toán học.

Xác suất được tính là α/(α+β). Chính là việc có thể mô hình hóa kinh nghiệm và kiến thức tiên nghiệm hoặc trực giác lĩnh vực thành các con số như "Tỷ lệ thành công, tỷ lệ lỗi, tỷ lệ phản hồi... là 20%". Ở đây 2 và 8 là cường độ của niềm tin và con số càng lớn thì cường độ niềm tin càng lớn. Ví dụ, 20 và 80 có cùng tỷ lệ thành công 20% như 2 và 8, nhưng cường độ niềm tin lớn hơn nhiều.

α và β là các siêu tham số (hyperparameters) mà chúng ta tự gán (hoặc đo lường từ dữ liệu hiệu suất trong quá khứ) để chúng ta có thể mô hình hóa kiến thức tiên nghiệm. Các giá trị này được điều chỉnh bởi Động cơ Bayesian thành các giá trị thực tế khi dữ liệu (bằng chứng) tích lũy. Đây là điểm bắt đầu của quá trình theo dõi mức độ phù hợp của xác suất chủ quan với dữ liệu thực tế.

Nói cách khác, điểm bắt đầu của mô hình này là nó bắt đầu với một trí tuệ sở hữu kinh nghiệm, chứ không phải ở trạng thái không có dữ liệu.

2. Tín hiệu từ hiện trường: 'Phân phối Nhị thức (Binomial Distribution)' như một hàm khả năng

Các sự kiện xảy ra trong lĩnh vực bán hàng (các cuộc họp, yêu cầu báo giá, v.v.) cuối cùng dẫn đến các kết quả rời rạc: một 'tín hiệu thành công' hoặc một 'tín hiệu không thành công'. Công cụ nắm bắt điều này là phân phối Nhị thức.

2.1 Định nghĩa toán học

Xác suất thành công k lần khi một sự kiện có xác suất thành công là p được thực hiện n lần là như sau:

Công thức này định lượng (Khả năng, likelihood) 'sự thật (Evidence, bằng chứng)' nghe được từ hiện trường. đo lường mức độ xác suất p mà chúng ta giả định phù hợp với kết quả thực tế k. Hệ thống coi kết quả của mỗi bước được nhập bởi nhân viên bán hàng là phép thử nhị thức này, thay thế các tương tác thô bằng các tín hiệu toán học tinh tế.

2.2 Trọng số bằng chứng (Weight of Evidence, WoE)

Tại sao một số tín hiệu có trọng số cao trong khi những tín hiệu khác lại thấp?

Mô hình Bayesian được sử dụng trong tập này phản ánh khái niệm Trọng số bằng chứng (WoE, Weight of Evidence)—được sử dụng bởi Claude Shannon trong Lý thuyết thông tin và Alan Turing trong việc giải mã—vào dữ liệu bằng chứng của hàm khả năng phân phối Nhị thức.

Đó là logarit của Tỷ lệ Khả năng (Likelihood Ratio) giữa xác suất một tín hiệu xuất hiện trong nhóm 'thành công' và xác suất nó xuất hiện trong nhóm 'thất bại'. Lý do tại sao việc "đề cập đến đối thủ cạnh tranh ở giai đoạn đàm phán hợp đồng cuối cùng" là chí mạng là vì Lượng thông tin thu được (Information Gain) khi tín hiệu đó xảy ra ở giai đoạn đó lớn hơn nhiều so với giai đoạn ban đầu.

Việc sử dụng trọng số thang đo logarit là kết quả của việc phản ánh 'mật độ thông tin' này một cách toán học.

2.3 Giải thích

Công thức này định lượng 'sự thật (Evidence)' từ hiện trường bằng cách phản ánh WoE. đo lường mức độ xác suất p mà chúng ta giả định phù hợp với kết quả thực tế k. Hệ thống coi kết quả của mỗi bước được nhập bởi nhân viên bán hàng là phép thử nhị thức này, thay thế các tương tác thô bằng các tín hiệu toán học tinh tế.

3. Sự kết hợp của kiến thức: Ma thuật của 'Tiên nghiệm liên hợp (Conjugate Prior)'

Đỉnh cao của Động cơ Bayesian nằm ở quy trình cập nhật tạo ra 'sự chắc chắn của ngày mai' bằng cách thêm 'tín hiệu của ngày hôm nay' vào 'kiến thức của ngày hôm qua'.

3.1 Kết hợp toán học (Cập nhật hậu nghiệm)

Theo định lý Bayes, xác suất Hậu nghiệm (Posterior) được tính như sau:

Lúc này, khi phân phối Beta (Tiên nghiệm, prior: kiến thức tiên nghiệm, niềm tin chủ quan) và phân phối Nhị thức (Khả năng, likelihood: dữ liệu bằng chứng) được kết hợp, một sự hòa hợp toán học tuyệt vời sẽ xảy ra. Quy trình toán học của sự kết hợp này sẽ được giải thích trong một bài viết riêng biệt mổ xẻ về phân phối Beta, nhưng công thức kết quả dưới đây có thể được xác nhận qua nhiều sách giáo khoa toán học khác nhau.

Nhìn vào kết quả, phân phối hậu nghiệm cũng trở thành một phân phối Beta với các tham số α' = α + k và β'= β+ (n-k), mang hình thái của phân phối Beta tiên nghiệm.

3.2 Sự ưu việt của Giải pháp giải tích (Analytical Solution)

Đây chính là sức mạnh của Tiên nghiệm liên hợp (phân phối hậu nghiệm, kết hợp phân phối Beta chứa kiến thức tiên nghiệm và phân phối Nhị thức là phân phối dữ liệu bằng chứng, hội tụ ngược lại về phân phối Beta). Việc cập nhật được hoàn tất bằng cách chỉ cần thêm tín hiệu vào giá trị hiện có mà không cần các phép toán tích phân phức tạp. Trong thuật ngữ khoa học máy tính, đây là một phép toán thời gian hằng số với độ phức tạp tính toán là O(1). Đây là lý do tại sao hầu như không có tải trọng máy chủ ngay cả khi xử lý hàng nghìn hoặc hàng chục nghìn đơn hàng trong thời gian thực—là cơ sở cho mệnh đề "Phép tính nhẹ như lông hồng, nhưng kết quả nặng như bàn thạch".

4. Sự hợp lý về mặt kỹ thuật: Tại sao lại là 'Mô hình Beta-Nhị thức' cho vấn đề này?

Các giá trị kỹ thuật sở hữu bởi Deep Learning Bayesian và MCMC (Markov Chain Monte Carlo) là tài sản cốt lõi của khoa học dữ liệu hiện đại. Tuy nhiên, mỗi công cụ đều có mục đích sử dụng tối ưu, nơi các khả năng của nó có thể được phát huy tối đa.

Ví dụ, khi tính toán xác suất nhập hàng đúng hạn của một Đơn đặt hàng (PO) thông qua Động cơ Bayesian Exa, mô hình mô phỏng MCMC rất hiệu quả. Điều này là do mô hình MCMC có khả năng tính toán hàng loạt (Batch) quy mô lớn và có thể phản ánh một cách tinh vi không chỉ dữ liệu giao hàng bình thường trung bình mà còn cả dữ liệu gọi là 'xảy ra sự cố (Outlier)' như 'chậm giao hàng'.

Cuối cùng, tính linh hoạt để lựa chọn và áp dụng mô hình tối ưu theo các biến số phức tạp tại hiện trường là điều tối quan trọng, và tầm quan trọng của việc sử dụng mô hình phù hợp như vậy không bao giờ có thể được nhấn mạnh quá mức.

4.1 Vai trò của MCMC và Deep Learning Bayesian

MCMC xuất sắc trong việc xấp xỉ các phân phối xác suất cao chiều, nơi hàng nghìn biến số đan xen với nhau. Bayesian dựa trên Deep Learning là điều cần thiết để trích xuất các mẫu phức tạp từ dữ liệu phi cấu trúc (hình ảnh, giọng nói, v.v.). Đây là những giải pháp mạnh mẽ tìm ra câu trả lời thông qua vô số lần mô phỏng và lấy mẫu.

(Công thức xác suất chấp nhận mẫu của MCMC: Yêu cầu hàng chục nghìn lần thực hiện lặp lại)

4.2 Thế mạnh độc tôn của Mô hình Beta-Nhị thức

Mặt khác, trong các lĩnh vực có mục tiêu rõ ràng về 'thành công và thất bại' như dự đoán tỷ lệ thành công bán hàng, Giải pháp giải tích (Analytical Solution) được cung cấp bởi mô hình Beta-Nhị thức trở thành 'Tiêu chuẩn vàng'.

Tính thời gian thực: Có thể phản hồi tức thì mà không cần lấy mẫu nặng nề.

Khả năng giải thích: Nó có thể giải thích rõ ràng tại sao xác suất thay đổi thông qua việc tăng hoặc giảm α và β.

Chúng tôi sẽ sử dụng Deep Learning và MCMC cho các vấn đề phức tạp hơn, nhưng tại thời điểm này, nơi yêu cầu đưa ra quyết định kinh doanh nhanh chóng, chúng tôi đã chọn phương pháp rõ ràng và trang nhã nhất này.

5. Cuộc cách mạng về kiến trúc: Ước lượng Bayesian đệ quy (Recursive Bayesian Estimation)

Trong thời đại dữ liệu bùng nổ, việc tải lại 'tất cả dữ liệu trong quá khứ' mỗi lần là không hiệu quả. Động cơ của mô hình này áp dụng kiến trúc đệ quy (Recursive) tập trung vào 'tinh túy của thông tin'.

Đây là cội rễ sâu xa nhất của mô hình này;

Tất cả các nhật ký cuộc họp trong quá khứ đã được nén (Compression) hoàn hảo chỉ thành hai con số, α và β, của trạng thái hiện tại (phân phối hậu nghiệm được cập nhật bởi sự kết hợp của kiến thức tiên nghiệm và bằng chứng dữ liệu). Khi có một tín hiệu mới đến, hệ thống chỉ cần thêm tín hiệu đó vào trạng thái hiện tại thay vì lục lọi các nhật ký trong quá khứ.

Nguyên lý hiệu chỉnh quỹ đạo của NASA và hiệu chỉnh vị trí thời gian thực của xe tự lái

Lý thuyết này chia sẻ cùng một dòng dõi toán học chính xác như Bộ lọc Kalman (Kalman Filter), kỹ thuật được sử dụng để theo dõi vị trí của tàu vũ trụ trong chương trình Apollo của NASA như một kỹ thuật để suy luận trạng thái trong thời gian thực bất cứ khi nào dữ liệu đến một cách tuần tự.

Thống kê truyền thống bắt đầu phân tích "sau khi tất cả dữ liệu được thu thập", nhưng Bayesian đệ quy đưa ra các phán đoán "ngay khi thông tin phát sinh". Đây là thuật toán nghiêm ngặt nhất để quản lý sự không chắc chắn trong môi trường ERP, nơi tính thời gian thực là sự sống còn.

Khi toán học trở thành công cụ cho kinh doanh

Qua [Phụ lục Phần 1], chúng ta đã thấy trật tự toán học ẩn bên dưới tảng băng trôi khổng lồ của Động cơ Bayesian.

Phân phối Beta là chiếc bình chứa đựng kinh nghiệm của bạn,

Phân phối Nhị thức là bộ lọc tiếp nhận những tín hiệu nóng hổi từ hiện trường.

Và thông qua phước lành của Tiên nghiệm liên hợp, hệ thống đưa ra sự tin tưởng chính xác nhất theo cách nhẹ nhàng nhất.

Đây không phải là một công cụ thống kê đơn giản. Nó là 'La bàn quyết định' theo dõi và dẫn dắt doanh nghiệp của bạn một cách tinh vi như quỹ đạo tàu vũ trụ.

[Thông báo tiếp theo: Phần 2]

Vào ngày 'Im lặng' khi không có dữ liệu nào đến, tại sao xác suất lại giảm?

Lần tới, đã đến lúc kiểm tra bên trong của 'Nghịch lý của sự im lặng và trọng số Log' từ góc độ của Lý thuyết thông tin.

Bayesian EXAWin-Rate Forecaster

Phân tích tín hiệu từ các cuộc đàm phán trong thời gian thực bằng cập nhật Bayesian để dự đoán xác suất thành công. Với EXAWin, bán hàng trở thành khoa học dữ liệu hoàn hảo.